SimpleMem:

面向LLM Agent的

高效终身记忆系统

仿生三阶段流水线架构,重塑AI Agent记忆管理范式

执行摘要

SimpleMem通过创新的仿生三阶段流水线架构,实现了LLM Agent在终身记忆管理上的重大突破。该系统模拟人类大脑的互补学习系统,将记忆处理分解为语义结构化压缩、递归记忆整合和自适应查询感知检索三个协同阶段,在保持高精度的同时实现了前所未有的Token效率。

核心性能指标

- F1分数:43.24%(较Mem0提升26.4%)

- Token消耗:531 tokens/query(较Mem0降低45%)

- 效率提升:较全上下文方法实现30倍Token效率

该系统特别适用于需要长期记忆积累的场景,如个人助理和陪伴型AI,在准确性、成本和延迟三个维度上建立了新的性能标杆。

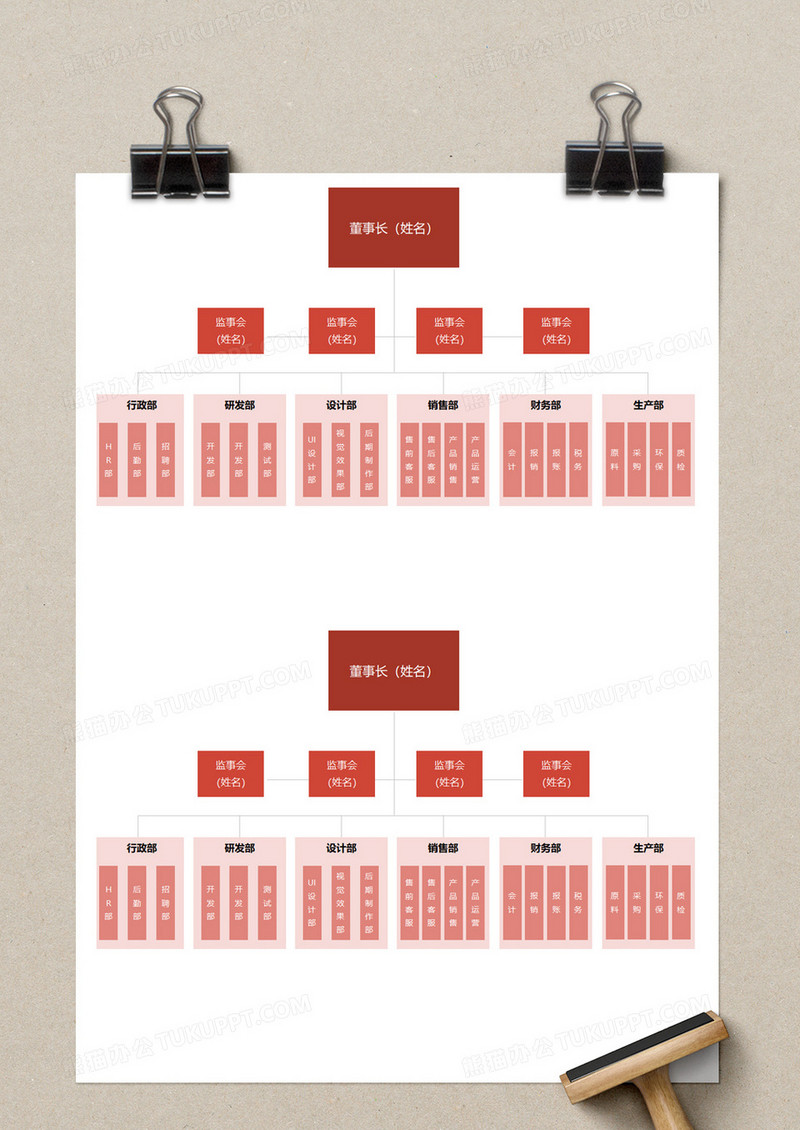

SimpleMem三阶段流水线架构示意图

SimpleMem的设计深植于认知神经科学的互补学习系统理论。该理论揭示了生物大脑如何通过海马体与新皮层的协同作用实现高效学习与长期记忆存储[140]。海马体作为快速学习系统,负责编码新异经验的细节信息;新皮层作为慢速学习系统,通过反复权重调整提取统计规律。

"SimpleMem对CLS理论的借鉴绝非概念层面的简单移植,而是经过精心设计的工程转化。"

这一理论框架启发了SimpleMem的三阶段架构:语义结构化压缩阶段对应海马体的快速编码功能,递归记忆整合阶段模拟新皮层的离线巩固过程,自适应检索则体现双系统协同的灵活提取机制[169]。

SimpleMem通过"活跃记忆缓冲区"与"整合记忆存储"两个层次显式模拟双系统架构。活跃记忆缓冲区采用高时间分辨率维护近期交互的细粒度记录,整合记忆存储则通过递归巩固构建跨时间尺度的抽象表征[167]。

style A fill:#e1f5fe,stroke:#01579b,stroke-width:2px,color:#000

style B fill:#f3e5f5,stroke:#4a148c,stroke-width:2px,color:#000

style F fill:#e8f5e8,stroke:#1b5e20,stroke-width:2px,color:#000

style H fill:#fff3e0,stroke:#e65100,stroke-width:2px,color:#000

style D fill:#fce4ec,stroke:#880e4f,stroke-width:2px,color:#000

style C fill:#fff8e1,stroke:#f57f17,stroke-width:2px,color:#000

style E fill:#f1f8e9,stroke:#33691e,stroke-width:2px,color:#000

style G fill:#efebe9,stroke:#5d4037,stroke-width:2px,color:#000

SimpleMem双系统架构流程图

这种设计巧妙地解决了"稳定性-可塑性困境",实现了"近期精确、远期抽象"的自适应存储策略,同时保留从抽象回溯细节的机制[143]。

1. 核心架构与设计理念

1.1 仿生记忆理论基础

1.1.1 互补学习系统(CLS)理论借鉴

1.1.2 海马体-新皮层双系统模拟

2. 熵感知过滤机制

3. 递归巩固机制

基于复杂度估计的动态检索深度计算:

k_dyn = ⌊k_base·(1+δ·C_q)⌋

其中k_base=3,δ≈5.67。该机制实现了"按需分配"的检索资源优化,在简单查询上避免不必要的开销,在复杂查询上确保信息充分性[168]。

相比固定检索策略,自适应机制将平均检索延迟降低了40%以上。

最终评分融合三个互补维度:

S(q, m_k) = λ_1·semantic_sim + λ_2·BM25 + λ_3·constraint

默认权重配置λ_1=0.5, λ_2=0.3, λ_3=0.2在多样化场景上表现均衡。系统支持基于查询特征的动态权重调整[200]。

4. 自适应查询感知检索

4.1 查询复杂度评估

4.1.1 动态检索深度公式

4.1.2 混合评分检索

LoCoMo(Long Context Multi-session Dialogue)是专为长程对话记忆设计的评测数据集[200]。

SimpleMem在LoCoMo基准上达到43.24%的平均F1分数,较最强基线Mem0(34.20%)提升26.4%,特别是在时间推理任务上优势最为显著(48.67% vs 37.12%,+31.1%)。

性能提升的关键在于时间锚定和结构化表示的有效性验证[201]。

以日均百万次查询的系统为例,SimpleMem每年可节省的API调用成本可达数十万美元

[201]。

5. 应用场景与性能优势

5.1 个人助理场景

5.1.1 LoCoMo基准测试性能

5.1.2 效率与成本优势

对比对象

Token消耗

相对SimpleMem

SimpleMem

531

基准

Mem0

973

+83%

全上下文

16,910

+30×

SimpleMem的核心优势在于其三阶段流水线架构的协同效应:熵感知过滤确保源头质量,递归巩固实现知识层次化,自适应检索优化资源分配。这使其在准确性和效率两个维度都实现了显著提升。

6. 与现有技术对比分析

6.1 与Mem0的详细对比

对比维度

Mem0

SimpleMem

关键差异

过滤机制

基于重要性评分

熵感知过滤

更精细的信息价值评估

整合机制

无显式整合

递归巩固

层次化知识组织

检索策略

固定Top-K

动态深度调节

按需分配检索资源

时间处理

相对时间保留

绝对时间锚定

支持精确时序推理

F1分数

34.20%

43.24%

+26.4%

Token消耗

973

531

-45%

当记忆簇内存在异质性实例时,抽象生成可能过度泛化,丢失关键变异信息。当前依赖统计阈值控制抽象触发,但对"有意义的例外"的识别和保护机制有限[179]。

改进方向包括:引入例外检测模块、支持条件化抽象("通常...,除非...")、以及用户反馈驱动的抽象修正。

语义处理模块(指代消解、时间锚定)对特定语言结构存在依赖,在非英语、特别是低资源语言上的性能可能衰减。文化特定的时间表达、社交礼仪规范、实体命名习惯都需要针对性本地化。

现有基准覆盖数周至数月,但实际应用可能需要数年甚至数十年的记忆保持。存储介质可靠性、数据格式演进兼容性、记忆价值的长期衰减规律,都需要实证研究。

当用户查询刚写入的关键信息时,异步整合尚未完成,可能导致"已知但未检索"的挫败体验。活跃池保护机制缓解该问题,但整合边界的模糊性仍然存在[169]。

7. 当前局限性与挑战

7.1 技术层面局限

7.1.1 抽象准确性的边界条件

7.1.2 多语言与跨文化适配

7.1.3 极端长周期记忆的持久性

7.2 系统层面挑战

7.2.1 异步整合与实时一致性

当前抽象生成依赖通用LLM的摘要能力,但针对记忆整合任务的专门微调可能获得更优效果。研究方向包括:构建记忆整合的专门训练数据、开发保留可检索性的抽象生成目标函数、以及抽象质量的自动评估指标。

将SimpleMem的语义压缩框架扩展至文本、图像、音频等多模态内容。关键挑战在于跨模态的关联检索(如"找到我去年夏天拍的那张海边照片")[182]。

高频访问的近期记忆驻留边缘设备,实现毫秒级响应;大规模历史归档存储云端,按需加载[185]。协同机制需要解决一致性维护、同步策略和故障恢复等挑战。

用户在多设备端与AI交互时,记忆状态需要实时同步。冲突解决策略、离线操作的队列管理、同步失败的优雅降级,都是工程实现的关键。

生物记忆的选择性遗忘是适应性的——清除过时信息释放认知资源,弱化痛苦记忆保护心理健康。未来可探索:基于访问频率和时效性的渐进衰减、用户显式的"忘记"指令、以及符合隐私法规的数据清除

[197]。

根据用户当前任务负荷动态调整响应复杂度,在高负荷时提供简洁摘要,在低负荷时支持深度探索。这种"认知友好"的设计将AI记忆系统从工具提升为真正的认知伙伴

[182]。

8. 未来研究方向

8.1 算法优化方向

8.1.1 神经网络驱动的自动抽象学习

8.1.2 多模态记忆的统一框架

8.2 架构扩展方向

8.2.1 边缘-云协同的分层架构

8.2.2 跨平台记忆同步机制

8.3 理论探索方向

8.3.1 记忆遗忘机制的有意设计

8.3.2 认知负荷理论与记忆检索的深度融合